引言:智能決策的核心引擎

在人工智能的宏偉藍圖中,強化學習正成為驅動智能體在復雜、動態環境中自主決策的核心引擎。與依賴大量標注數據的監督學習不同,強化學習通過智能體與環境的持續交互來學習最優策略,這種試錯與獎勵驅動的范式,使其在游戲AI、機器人控制、自動駕駛、資源優化等開放性問題中展現出巨大潛力。而Python,憑借其簡潔的語法、豐富的科學計算庫和活躍的社區,已成為學習和實踐強化學習算法的首選語言。掌握基于Python的強化學習,不僅是理解前沿AI的關鍵,更是開發下一代智能應用軟件的基礎。

一、理解強化學習的核心范式與基礎構件

強化學習圍繞著 智能體(Agent)、環境(Environment)、狀態(State)、動作(Action) 和 獎勵(Reward) 這幾個核心概念展開。其核心思想是:智能體在某個狀態下采取一個動作,環境隨之轉移到新狀態并給予一個獎勵信號,智能體的目標是學習一個策略(Policy),以最大化長期累積獎勵。

- 核心概念與馬爾可夫決策過程(MDP):MDP為強化學習提供了形式化框架,它假設未來狀態僅依賴于當前狀態和動作(馬爾可夫性)。理解狀態轉移概率、策略函數、價值函數(狀態價值函數V(s)和動作價值函數Q(s, a))以及貝爾曼方程,是打開強化學習大門的鑰匙。

- 探索與利用的權衡:這是強化學習的根本挑戰。智能體需要在嘗試新動作以發現更好策略(探索)和利用當前已知的最佳動作以獲得獎勵(利用)之間取得平衡。ε-貪婪策略、Softmax策略等是解決這一問題的經典方法。

二、掌握主流的Python強化學習算法與實現

Python生態為快速實現和實驗各類算法提供了強大支持,主要庫包括 Gym/ Gymnasium(環境標準庫)、Stable-Baselines3(算法實現庫)、PyTorch/TensorFlow(深度學習框架)等。

- 經典表格型方法:適用于狀態和動作空間離散且較小的問題。

- Q-Learning:一種離策略(off-policy)的時間差分學習算法,直接優化動作價值函數Q(s, a)。其更新公式

Q(s,a) ← Q(s,a) + α [r + γ * max_a' Q(s',a') - Q(s,a)]直觀體現了基于未來最優估計的當前值更新。

- SARSA:一種在策略(on-policy)算法,其更新基于實際執行的下一動作,公式為

Q(s,a) ← Q(s,a) + α [r + γ * Q(s',a') - Q(s,a)]。

- 深度強化學習(DRL)方法:當狀態空間高維(如圖像)或連續時,需用深度神經網絡作為函數逼近器。

- Deep Q-Network (DQN):將Q-Learning與深度神經網絡結合,通過經驗回放緩沖區和目標網絡解決數據相關性與目標不穩定的問題,是處理高維觀測的里程碑。

- 策略梯度方法:如REINFORCE,直接參數化策略并沿提高期望回報的方向調整參數。其進階版本Actor-Critic架構融合了價值函數(Critic)和策略函數(Actor),通過Critic提供的優勢估計來降低策略更新的方差,代表算法有A2C/A3C、PPO(近端策略優化)和SAC(柔性演員-評論家)。其中,PPO因其良好的性能與穩定性,已成為當前實踐中最受歡迎的算法之一。

三、開發流程:從原型到穩健的智能算法軟件

基于Python開發一個強化學習解決方案,是一個迭代的工程過程。

- 問題定義與環境構建:使用Gym接口定義或封裝你的問題環境。確保狀態、動作空間和獎勵函數設計合理,獎勵函數尤其關鍵,它引導著智能體的學習目標。

- 算法選擇與原型開發:根據問題特性(離散/連續動作、觀測類型等)選擇基礎算法。利用Stable-Baselines3等庫可以快速搭建訓練原型。核心代碼通常包括:環境初始化、模型定義、訓練循環(收集經驗、更新模型)、模型保存與評估。

- 訓練、調試與超參數優化:強化學習訓練不穩定、對超參數敏感。需要系統性地調整學習率、折扣因子、網絡結構、探索參數等。使用TensorBoard等可視化工具監控訓練曲線(如回合獎勵、策略熵)至關重要。

- 性能評估與部署:在獨立的測試環境中評估訓練好的策略,確保其泛化能力和魯棒性。將訓練好的模型集成到最終的應用程序或服務中,這可能涉及模型格式轉換、創建推理API或嵌入到邊緣設備。

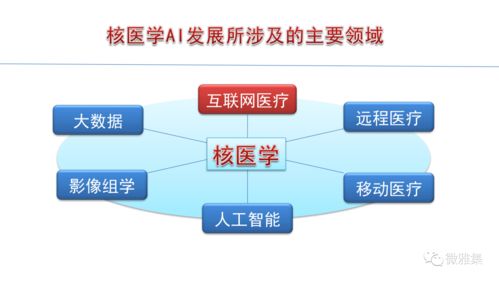

四、應對現實世界的人工智能挑戰

將強化學習從實驗室環境推向現實世界,面臨著獨特挑戰,這也是智能算法軟件開發的前沿方向。

- 樣本效率與安全探索:現實交互成本高昂。研究如模型基強化學習、示范學習、安全約束策略優化等方法,以提高學習效率并確保探索過程安全。

- 泛化與遷移:使在一個環境中學到的策略能夠適應相似但不同的新環境。元強化學習和領域隨機化是有效的技術途徑。

- 多智能體協作與競爭:許多現實問題涉及多個智能體。多智能體強化學習研究智能體之間的交互,探索合作、競爭與溝通的機制。

- 可解釋性與可靠性:對于關鍵應用,需要理解智能體為何做出特定決策,并確保其行為穩定可靠。這是將強化學習算法轉化為可信賴的基礎軟件的重要組成部分。

##

Python強化學習算法是連接人工智能理論與強大應用軟件的橋梁。從深入理解MDP和貝爾曼最優原理,到熟練運用DQN、PPO等先進算法解決實際問題,再到應對樣本效率、安全部署等工程挑戰,這一學習路徑不僅培養開發智能算法的硬核技能,更塑造一種讓機器通過交互與反思來優化決策的系統性思維。隨著AI不斷滲透至各行各業,掌握這項技術,意味著你正親手參與構建能夠自主適應、學習并戰勝復雜挑戰的下一代智能系統的基礎軟件層。